Ca tourne sur la RAM plutôt que sur la VRAM ? Comment ça peut être rapide alors ?

Il n'y aurait donc plus besoin de GPUs avec beaucoup de VRAM ?

Il n'y aurait donc plus besoin de GPUs avec beaucoup de VRAM ?

Un partie du LLM est chargé sur le GPU en vRAM, une autre partie est chargé en RAM le calcul se faisant sur CPU. (Modele type GGUF avec llama.cpp)

Avec un bon proc, tu es à ~15 token/s sans opti.

J'ai essayé de mettre en SWAP plutot qu'en RAM aussi, là par contre les perfs tombe à 2 token/s au mieux.

D'ailleurs il y a des nouvelle technos pour charger selectivement le modele plusieurs fois.

Les optis avancent trés vite dans le secteur.

Avec un bon proc, tu es à ~15 token/s sans opti.

J'ai essayé de mettre en SWAP plutot qu'en RAM aussi, là par contre les perfs tombe à 2 token/s au mieux.

D'ailleurs il y a des nouvelle technos pour charger selectivement le modele plusieurs fois.

Les optis avancent trés vite dans le secteur.

Mon propos est imaginaire et fictif, il n'implique donc aucun fait ou élément réel et toute ressemblance serait fortuite

il y a 4 mois

Sponsorisé

Connectez-vous pour masquer les pubsSwampDrainer

9 mois

Parce qu'on aimerait bien se passer de payer 22,99 tous les mois pour GPT

Parce qu'on ne veut pas d'une API connectee à un aspirateur de données

Il nous faut des LLMs maison mais qui soient aussi performants que GPT

Sinon, ça ne sert à rien

Donc il y a plusieurs LLMs locaux :

- Ollama propose un panel de plusieurs modèles interessants avec intégration (si vous faites du software, ça pèse quelques Go mais aucun n'arrive à la cheville de GPT)

- Open Chat (dans leurs bench ils explosent GPT)

- un nouveau que j'ai oublié (edit : il s'appelle JAN https://jan.ai/ )

https://jan.ai/ )

Visualisation du bordel type GPT :

https://bbycroft.net/llm?utm_source=chatgpt.com

https://bbycroft.net/llm?utm_source=chatgpt.com

Et vous ? Vos LLMs locaux c'est quoi ?

Parce qu'on ne veut pas d'une API connectee à un aspirateur de données

Il nous faut des LLMs maison mais qui soient aussi performants que GPT

Sinon, ça ne sert à rien

Donc il y a plusieurs LLMs locaux :

- Ollama propose un panel de plusieurs modèles interessants avec intégration (si vous faites du software, ça pèse quelques Go mais aucun n'arrive à la cheville de GPT)

- Open Chat (dans leurs bench ils explosent GPT)

- un nouveau que j'ai oublié (edit : il s'appelle JAN

Visualisation du bordel type GPT :

Et vous ? Vos LLMs locaux c'est quoi ?

Jamais réussi à avoir des résultats vraiment utiles en local

t'en es où ?

t'en es où ?

il y a 4 mois

Niveau 10

Mon propos est imaginaire et fictif, il n'implique donc aucun fait ou élément réel et toute ressemblance serait fortuite

il y a 4 mois

Victoire ! Les générateurs de code viennent de me faire gagner mes 10 premières minutes en me disant que pour couper une chaîne sur le dernier point, il faut

split /\.(?!.*\.)/, $string

Le problème, c'est qu'il faut aussi 10 minutes pour me convaincre que cette regex est la bonne.

split /\.(?!.*\.)/, $string

Le problème, c'est qu'il faut aussi 10 minutes pour me convaincre que cette regex est la bonne.

Certifié tous gaz.

il y a 4 mois

Des avis sur les cartes PNY ?

https://www.ldlc.pro/fiche/PB00710729.html

https://www.ldlc.pro/fiche/PB00710729.html

C'est moins cher qu''une 5090.

C'est moins cher qu''une 5090.

Certifié tous gaz.

il y a 4 mois

Zardoz

4 mois

Des avis sur les cartes PNY ?

https://www.ldlc.pro/fiche/PB00710729.html

https://www.ldlc.pro/fiche/PB00710729.html

C'est moins cher qu''une 5090.

C'est moins cher qu''une 5090.

Je pense que si l'objectif n'est que de faire de l'inférence avec ollama, la radeon rx 7900 XTX est beaucoup moins chère et possède la même quantité de VRAM :  https://www.amazon.fr/-/e[...]X-79XMERCB9/dp/B0BNLSW23M

https://www.amazon.fr/-/e[...]X-79XMERCB9/dp/B0BNLSW23M

Le soucis avec cette carte, c'est que ce n'est pas NVIDIA donc elle ne bénéficie pas de l'écosystème CUDA assez pratique en IA

Mais si c'est juste pour utiliser ollama, ça devrait être compatible.

Le soucis avec cette carte, c'est que ce n'est pas NVIDIA donc elle ne bénéficie pas de l'écosystème CUDA assez pratique en IA

Mais si c'est juste pour utiliser ollama, ça devrait être compatible.

il y a 4 mois

Je pense que si l'objectif n'est que de faire de l'inférence avec ollama, la radeon rx 7900 XTX est beaucoup moins chère et possède la même quantité de VRAM :  https://www.amazon.fr/-/e[...]X-79XMERCB9/dp/B0BNLSW23M

https://www.amazon.fr/-/e[...]X-79XMERCB9/dp/B0BNLSW23M

Le soucis avec cette carte, c'est que ce n'est pas NVIDIA donc elle ne bénéficie pas de l'écosystème CUDA assez pratique en IA

Mais si c'est juste pour utiliser ollama, ça devrait être compatible.

Le soucis avec cette carte, c'est que ce n'est pas NVIDIA donc elle ne bénéficie pas de l'écosystème CUDA assez pratique en IA

Mais si c'est juste pour utiliser ollama, ça devrait être compatible.

Effectivement, c'est un beau rapport VRAM/prix.

Mais comme tu le remarques, le support CUDA+Debian est terra incognita pour moi, alors qu'avec NVIDIA ça tourne.

Mais comme tu le remarques, le support CUDA+Debian est terra incognita pour moi, alors qu'avec NVIDIA ça tourne.

Certifié tous gaz.

il y a 4 mois

Effectivement, c'est un beau rapport VRAM/prix.

Mais comme tu le remarques, le support CUDA+Debian est terra incognita pour moi, alors qu'avec NVIDIA ça tourne.

Mais comme tu le remarques, le support CUDA+Debian est terra incognita pour moi, alors qu'avec NVIDIA ça tourne.

il y a 4 mois

Justement CUDA c'est NVIDIA

Avec ce GPU AMD, il te faudra ROCm

Avec ce GPU AMD, il te faudra ROCm

Si tu préfères, j'en ai chié pas mal pour monter un setup qui marche. C'est pas tant ollama, qui roule comme un horloge, que la génération d'image où tu as un tas de dépendances sur les versions (telle version minimale des drivers graphiques pour supporter tes cartes MAIS PAS supérieure à ce que ton OS/noyau supporte, telle version précise de Python).

Changer une pièce, c'est pratiquement la certitude de tomber dans un trou noir comme je viens de l'apprendre à mes dépens en faisant un bête apt upgrade (24 heures de down, et j'ai été chanceux).

Donc changer mon fusil d'épaule pour passer de NVIDIA à AMD, c'est une opération à risque. Pour le moment, j'ai deux 4060 Ti, total 32G qui m'ont coûté 600 balles pièce. C'est confortable mais on veut toujours un peu plus. Je regarde ce qui se pointe sur le marché pour aller au-delà sans me ruiner, ou en me ruinant modérément.

Changer une pièce, c'est pratiquement la certitude de tomber dans un trou noir comme je viens de l'apprendre à mes dépens en faisant un bête apt upgrade (24 heures de down, et j'ai été chanceux).

Donc changer mon fusil d'épaule pour passer de NVIDIA à AMD, c'est une opération à risque. Pour le moment, j'ai deux 4060 Ti, total 32G qui m'ont coûté 600 balles pièce. C'est confortable mais on veut toujours un peu plus. Je regarde ce qui se pointe sur le marché pour aller au-delà sans me ruiner, ou en me ruinant modérément.

Certifié tous gaz.

il y a 4 mois

Sponsorisé

Connectez-vous pour masquer les pubsSi tu préfères, j'en ai chié pas mal pour monter un setup qui marche. C'est pas tant ollama, qui roule comme un horloge, que la génération d'image où tu as un tas de dépendances sur les versions (telle version minimale des drivers graphiques pour supporter tes cartes MAIS PAS supérieure à ce que ton OS/noyau supporte, telle version précise de Python).

Changer une pièce, c'est pratiquement la certitude de tomber dans un trou noir comme je viens de l'apprendre à mes dépens en faisant un bête apt upgrade (24 heures de down, et j'ai été chanceux).

Donc changer mon fusil d'épaule pour passer de NVIDIA à AMD, c'est une opération à risque. Pour le moment, j'ai deux 4060 Ti, total 32G qui m'ont coûté 600 balles pièce. C'est confortable mais on veut toujours un peu plus. Je regarde ce qui se pointe sur le marché pour aller au-delà sans me ruiner, ou en me ruinant modérément.

Changer une pièce, c'est pratiquement la certitude de tomber dans un trou noir comme je viens de l'apprendre à mes dépens en faisant un bête apt upgrade (24 heures de down, et j'ai été chanceux).

Donc changer mon fusil d'épaule pour passer de NVIDIA à AMD, c'est une opération à risque. Pour le moment, j'ai deux 4060 Ti, total 32G qui m'ont coûté 600 balles pièce. C'est confortable mais on veut toujours un peu plus. Je regarde ce qui se pointe sur le marché pour aller au-delà sans me ruiner, ou en me ruinant modérément.

T'as raison si j'étais toi je ne tenterais pas non plus.

Tu dépends de l'IA pour ton travail ou tu fais ça dans ton temps libre ?

Tu dépends de l'IA pour ton travail ou tu fais ça dans ton temps libre ?

il y a 4 mois

Vous recommandez quoi comme LLM local pour faire de l'extraction de données? J'utilise Gemini, ça fait le taf proprement mais j'aimerais avoir une solution locale. J'explique mon usage: je lui donne un prompt assez gros avec la structure json attendue, puis je lui envoie des fichiers png (des tableaux de données) et txt, son rôle est d'extraire les infos de ces fichiers (les lires donc) et les mettre sous forme d'un json.

C'est tout ce que je demanderai à mon LLM local, je suppose qu'en 2k26 ça doit bien exister

C'est tout ce que je demanderai à mon LLM local, je suppose qu'en 2k26 ça doit bien exister

A chaque problème sa solution

il y a 4 mois

SeiferGamer57

4 mois

Vous recommandez quoi comme LLM local pour faire de l'extraction de données? J'utilise Gemini, ça fait le taf proprement mais j'aimerais avoir une solution locale. J'explique mon usage: je lui donne un prompt assez gros avec la structure json attendue, puis je lui envoie des fichiers png (des tableaux de données) et txt, son rôle est d'extraire les infos de ces fichiers (les lires donc) et les mettre sous forme d'un json.

C'est tout ce que je demanderai à mon LLM local, je suppose qu'en 2k26 ça doit bien exister

C'est tout ce que je demanderai à mon LLM local, je suppose qu'en 2k26 ça doit bien exister

Je pense que ce que tu veux faire doit être fait par étapes. D'abord extraire les données puis les mettre en forme (avec un autre modèle)

Pour détecter le texte à partir d'une image il faut que tu utilises ce qu'on appelle un OCR.

Après pour mettre tes données en forme tu peux utiliser n'importe-quel LLM généraliste que tu devrais fine-tuner pour ton cas d'usage.

Il n'y a pas de solution simple prête à être utilisée pour ton cas d'usage.

Pour détecter le texte à partir d'une image il faut que tu utilises ce qu'on appelle un OCR.

Après pour mettre tes données en forme tu peux utiliser n'importe-quel LLM généraliste que tu devrais fine-tuner pour ton cas d'usage.

Il n'y a pas de solution simple prête à être utilisée pour ton cas d'usage.

il y a 4 mois

OK, merci pour ta réponse, je vais continuer avec Gemini alors

A chaque problème sa solution

il y a 4 mois

SeiferGamer57

4 mois

OK, merci pour ta réponse, je vais continuer avec Gemini alors

En vrai je viens de regarder et qwen3vl semble pouvoir faire l'affaire. Je ne m'y connais pas vraiment en vrai je parle sans savoir.

Tu pourrais me filer un exemple d'image qui ressemble à ce que tu veux exploiter ? J'aimerais tester ça

Tu pourrais me filer un exemple d'image qui ressemble à ce que tu veux exploiter ? J'aimerais tester ça

il y a 4 mois

@SeiferGamer57 je viens de tester qwen3-vl:32b et je pense qu'il est capable de faire exactement ce dont tu as besoin.

il y a 4 mois

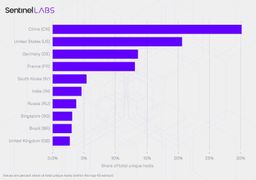

L'IA opensource pose un problème de sécurité.

Une étude se SentinelLABS a identifié 175,108 services ollama exposés publiquement dans 130 pays différents. Pour aggraver le problème, beaucoup de ces instances ont des API d'outils ouverts, des capacités de vision et des templates de prompt non censuré manquant de barrières de sécurité.

Ces systèmes requièrent une approche différente de la gouvernance : Contractuelle pour le déploiement en cloud ; Par des mécanismes d’assainissement (sanitation mechanisms) pour les réseaux résidentiels ou de tels contrats n'existent pas.

https://www.sentinelone.c[...]yond-platform-guardrails/

https://www.sentinelone.c[...]yond-platform-guardrails/

Vous la sentez venir ?

Une étude se SentinelLABS a identifié 175,108 services ollama exposés publiquement dans 130 pays différents. Pour aggraver le problème, beaucoup de ces instances ont des API d'outils ouverts, des capacités de vision et des templates de prompt non censuré manquant de barrières de sécurité.

Ces systèmes requièrent une approche différente de la gouvernance : Contractuelle pour le déploiement en cloud ; Par des mécanismes d’assainissement (sanitation mechanisms) pour les réseaux résidentiels ou de tels contrats n'existent pas.

Vous la sentez venir ?

Certifié tous gaz.

il y a 4 mois

Ammortel

4 mois

J'ai testé et ça ne m'a pas l'air prêt à l'utilisation professionnelle

Par contre ollama a très bien évolué depuis l'année dernière j'ai l'impression

Par contre ollama a très bien évolué depuis l'année dernière j'ai l'impression

il y a 4 mois

J'ai testé et ça ne m'a pas l'air prêt à l'utilisation professionnelle

Par contre ollama a très bien évolué depuis l'année dernière j'ai l'impression

Par contre ollama a très bien évolué depuis l'année dernière j'ai l'impression

il y a 4 mois

En ligne

108

Sur ce sujet0