coucou mes kheyou, vous le savez sans doute mais chat GPT est pas seul dans le game des IA

l'une d'elle est LLaMA qui a publier son code source, cependant le code source sans les données d'entrainement ben ça vaut pas grand chose

c'est pour ça qu'elles ont fuité magnet:?xt=urn:btih:ZXXDAUWYLRUXXBHUYEMS6Q5CE5WA3LVA&dn=LLaMA

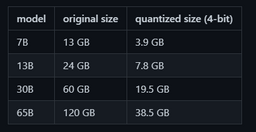

la version 65 GB peut être tentant mais elle demande 38 G de ram pour tourné et prend 3J a dl, et selon facebook la versio 7GB tient tête a chat GPT3 donc vous faites pas chier pour le moment

voici le code github que vous devez utilliser pour exploiter les données

https://github.com/ggerganov/llama.cpp

https://github.com/ggerganov/llama.cpp

paix sur vous

edit du 26/03/2023

si vous avez du mal a le faire fonctionner ou que vous voulez une interface a la chat gpt aller lire ce message

l'une d'elle est LLaMA qui a publier son code source, cependant le code source sans les données d'entrainement ben ça vaut pas grand chose

c'est pour ça qu'elles ont fuité magnet:?xt=urn:btih:ZXXDAUWYLRUXXBHUYEMS6Q5CE5WA3LVA&dn=LLaMA

la version 65 GB peut être tentant mais elle demande 38 G de ram pour tourné et prend 3J a dl, et selon facebook la versio 7GB tient tête a chat GPT3 donc vous faites pas chier pour le moment

voici le code github que vous devez utilliser pour exploiter les données

paix sur vous

edit du 26/03/2023

si vous avez du mal a le faire fonctionner ou que vous voulez une interface a la chat gpt aller lire ce message

Bon finalement j'ai pas réussi à le faire fonctionner, erreur de nccl, jl'ai pourtant installé via les repos d'Archlinux puis testé en téléchargeant directement sur le site de NVIDIA puis via conda.

Puis j'ai trouvé ce repo qui propose la même chose mais avec une Interface web à la CHATGPT, le frontend est fait via SvelteKit et l'API via fastapi, mais bon osef si vous voulez pas toucher au code. https://www.google.com/ur[...]Vaw2rDV8f1gz6bwTUgH0yUk6W

https://www.google.com/ur[...]Vaw2rDV8f1gz6bwTUgH0yUk6W

Suffit d'installer docker et docker-compose et suivre les instructions, (sous Linux en tout cas), on peut directement DL le 7B/30B dessus en le passant comme parameter.

C'est un peu lent mais ça fonctionne de mon côté, je viens de le faire fonctionner donc je peux pas vous dire ça donne quoi pour l'instant

Puis j'ai trouvé ce repo qui propose la même chose mais avec une Interface web à la CHATGPT, le frontend est fait via SvelteKit et l'API via fastapi, mais bon osef si vous voulez pas toucher au code.

Suffit d'installer docker et docker-compose et suivre les instructions, (sous Linux en tout cas), on peut directement DL le 7B/30B dessus en le passant comme parameter.

C'est un peu lent mais ça fonctionne de mon côté, je viens de le faire fonctionner donc je peux pas vous dire ça donne quoi pour l'instant

il y a 3 ans

Sponsorisé

Connectez-vous pour masquer les pubsMerci du topic khey je verrais sûrement ça ce soir

Première fois que je regrette de ne pas avoir une machine avec 64gb de RAM, ça fait partie des exceptions qui justifient la chose

Première fois que je regrette de ne pas avoir une machine avec 64gb de RAM, ça fait partie des exceptions qui justifient la chose

il y a 3 ans

Sc2Go1

3 ans

Merci du topic khey je verrais sûrement ça ce soir

Première fois que je regrette de ne pas avoir une machine avec 64gb de RAM, ça fait partie des exceptions qui justifient la chose

Première fois que je regrette de ne pas avoir une machine avec 64gb de RAM, ça fait partie des exceptions qui justifient la chose

j'ai 64GB de ram DDR5 car je suis un pigeon + un 13600k

mais je veins de test la version 65GB et ça prend VRAIMENT 3d

les autres versions

mais je veins de test la version 65GB et ça prend VRAIMENT 3d

les autres versions

il y a 3 ans

Morios

3 ans

coucou mes kheyou, vous le savez sans doute mais chat GPT est pas seul dans le game des IA

l'une d'elle est LLaMA qui a publier son code source, cependant le code source sans les données d'entrainement ben ça vaut pas grand chose

c'est pour ça qu'elles ont fuité magnet:?xt=urn:btih:ZXXDAUWYLRUXXBHUYEMS6Q5CE5WA3LVA&dn=LLaMA

la version 65 GB peut être tentant mais elle demande 38 G de ram pour tourné et prend 3J a dl, et selon facebook la versio 7GB tient tête a chat GPT3 donc vous faites pas chier pour le moment

voici le code github que vous devez utilliser pour exploiter les données

https://github.com/ggerganov/llama.cpp

https://github.com/ggerganov/llama.cpp

paix sur vous

edit du 26/03/2023

si vous avez du mal a le faire fonctionner ou que vous voulez une interface a la chat gpt aller lire ce message

https://onche.org/topic/6[...]t-a-vie/9#message_1167862

https://onche.org/topic/6[...]t-a-vie/9#message_1167862

l'une d'elle est LLaMA qui a publier son code source, cependant le code source sans les données d'entrainement ben ça vaut pas grand chose

c'est pour ça qu'elles ont fuité magnet:?xt=urn:btih:ZXXDAUWYLRUXXBHUYEMS6Q5CE5WA3LVA&dn=LLaMA

la version 65 GB peut être tentant mais elle demande 38 G de ram pour tourné et prend 3J a dl, et selon facebook la versio 7GB tient tête a chat GPT3 donc vous faites pas chier pour le moment

voici le code github que vous devez utilliser pour exploiter les données

paix sur vous

edit du 26/03/2023

si vous avez du mal a le faire fonctionner ou que vous voulez une interface a la chat gpt aller lire ce message

Je n'y connais absolument rien au IA (intelligence abominables) mais je te up pour la pertinence de ton topic.

La bise

++ DEUS EST MACHINA ++

++ DEUS EST MACHINA ++

La bise

il y a 3 ans

Je n'y connais absolument rien au IA (intelligence abominables) mais je te up pour la pertinence de ton topic.

La bise

La bise

cimer copain

il y a 3 ans

Ça vaut le coup d'attendre si le jump est digne de chatGPT-3 vers 4, je trouve 3.5 turbo extrêmement frustrant, essayer de trouver des moyens de lui extirper ce que tu veux prend parfois plus d'énergie que de chercher sur Google

J'ai pas renouvellé mon abonnement vu la limite de message avec chatGPT 4 pour l'instant

D'ailleurs je me suis inscris sur la waitlist de l'API de GPT4 day one et toujours rien

J'ai pas renouvellé mon abonnement vu la limite de message avec chatGPT 4 pour l'instant

D'ailleurs je me suis inscris sur la waitlist de l'API de GPT4 day one et toujours rien

il y a 3 ans

Ça vaut le coup d'attendre si le jump est digne de chatGPT-3 vers 4, je trouve 3.5 turbo extrêmement frustrant, essayer de trouver des moyens de lui extirper ce que tu veux prend parfois plus d'énergie que de chercher sur Google

J'ai pas renouvellé mon abonnement vu la limite de message avec chatGPT 4 pour l'instant

D'ailleurs je me suis inscris sur la waitlist de l'API de GPT4 day one et toujours rien

J'ai pas renouvellé mon abonnement vu la limite de message avec chatGPT 4 pour l'instant

D'ailleurs je me suis inscris sur la waitlist de l'API de GPT4 day one et toujours rien

faut savoir de ce que j'ai compris LLaMA peut go internet et donner des liens pour se justifier, on est vraiment sur quelque chose de plutôt balèze , moi c'est le fais de pas devoir attendre sur la version gratuite qui m'intéresse

il y a 3 ans

faut savoir de ce que j'ai compris LLaMA peut go internet et donner des liens pour se justifier, on est vraiment sur quelque chose de plutôt balèze , moi c'est le fais de pas devoir attendre sur la version gratuite qui m'intéresse

Qu'est ce que tu veux dire par attendre sur la version gratuite ? Ils en ont fait un produit et ont une waitlist avec pas mal de temps d'attente si tu payes pas ?

il y a 3 ans

Sponsorisé

Connectez-vous pour masquer les pubsQu'est ce que tu veux dire par attendre sur la version gratuite ? Ils en ont fait un produit et ont une waitlist avec pas mal de temps d'attente si tu payes pas ?

ben si y a trop de monde ça rame ou plante voir il te laisse pas entré

et la réponse met 2 plombe a sortir

et la réponse met 2 plombe a sortir

il y a 3 ans

ben si y a trop de monde ça rame ou plante voir il te laisse pas entré

et la réponse met 2 plombe a sortir

et la réponse met 2 plombe a sortir

Tu parles de llama ou chatGPT khey ?

Avec chatGPT plus j'ai pas vraiment remarqué que c'était beaucoup plus rapide que la version gratuite d'ailleurs

Avec chatGPT plus j'ai pas vraiment remarqué que c'était beaucoup plus rapide que la version gratuite d'ailleurs

il y a 3 ans

c'est pas 64 c'est 235.2 go

télécharge pas toute les version kheys tu seras encore la semaine pro

il y a 3 ans

télécharge pas toute les version kheys tu seras encore la semaine pro

je télécharge uniquement 7b 13b et 30b alors ?

bite

il y a 3 ans

En ligne

218

Sur ce sujet0